使用 Gemini 2.5 進行對話式圖像分割:重新定義視覺 AI

人工智能的快速發展已深刻改變了我們與視覺數據的互動方式,從最初的物體檢測到如今的複雜圖像分割技術,視覺 AI 正在不斷突破界限。Google 推出的 Gemini 2.5 引入了一項革命性功能:對話式圖像分割。這項技術讓使用者透過自然語言描述來精確分割圖像中的特定區域,例如「請分割圖片中穿著紅色外套的人」或「找出背景中的樹木」。相較於傳統的圖像分割方法,這種對話式交互方式不僅直觀,且能根據上下文動態調整,極大地提升了靈活性和應用範圍。本文將深入探討 Gemini 2.5 對話式圖像分割的技術原理、核心優勢、應用場景以及未來的發展潛力,揭示其如何為視覺 AI 開闢新的可能性。

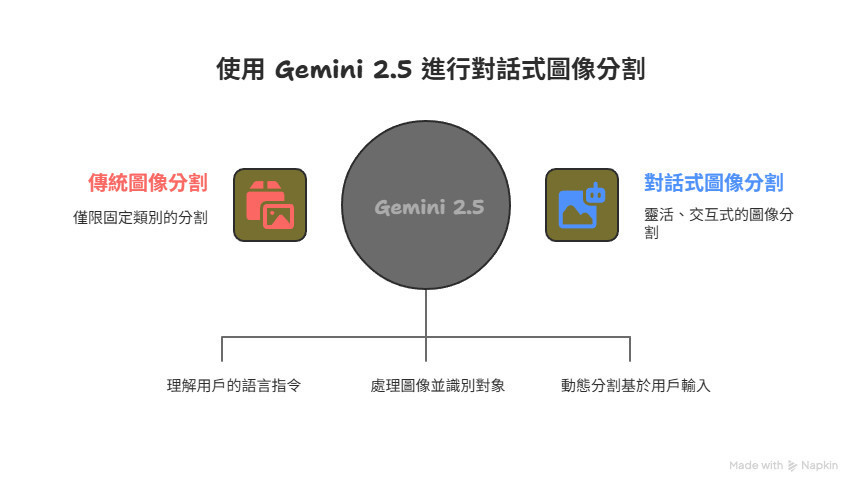

從傳統分割到對話式突破

圖像分割技術的目標是將圖像分成多個具有語義意義的區域,例如將一張照片中的人、車或背景分離。這項技術在醫療影像分析、自動駕駛、增強現實等領域有著廣泛應用。然而,傳統的圖像分割方法通常依賴於預訓練模型,這些模型僅能識別固定類別的物體,例如「人」或「車輛」,無法應對靈活或複雜的用戶需求。例如,若使用者希望分割「穿著紅色外套的人」或「背景中某棵特定的樹」,傳統模型往往無能為力。此外,這些方法通常需要專業工具或技術知識,限制了非專業用戶的參與。

Gemini 2.5 的對話式圖像分割解決了這些問題。透過結合自然語言處理與視覺分析,使用者無需專業背景即可通過簡單的語言指令完成複雜的分割任務。這種技術的出現標誌著視覺 AI 從靜態、預定義的任務處理走向了動態、交互式的用戶體驗,為多領域應用奠定了基礎。

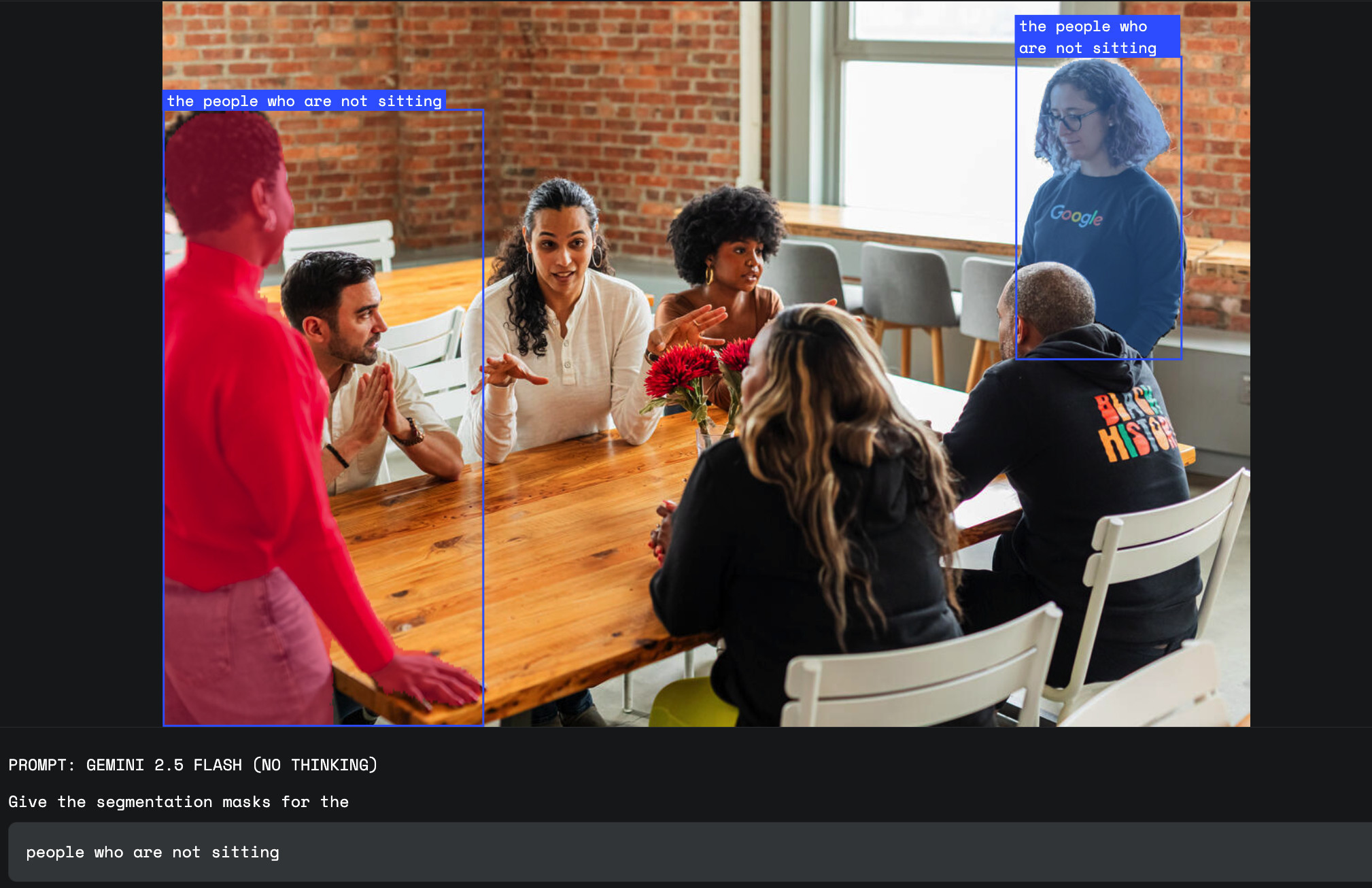

🔼Google 展示指令「標示出沒有坐著的人」執行結果

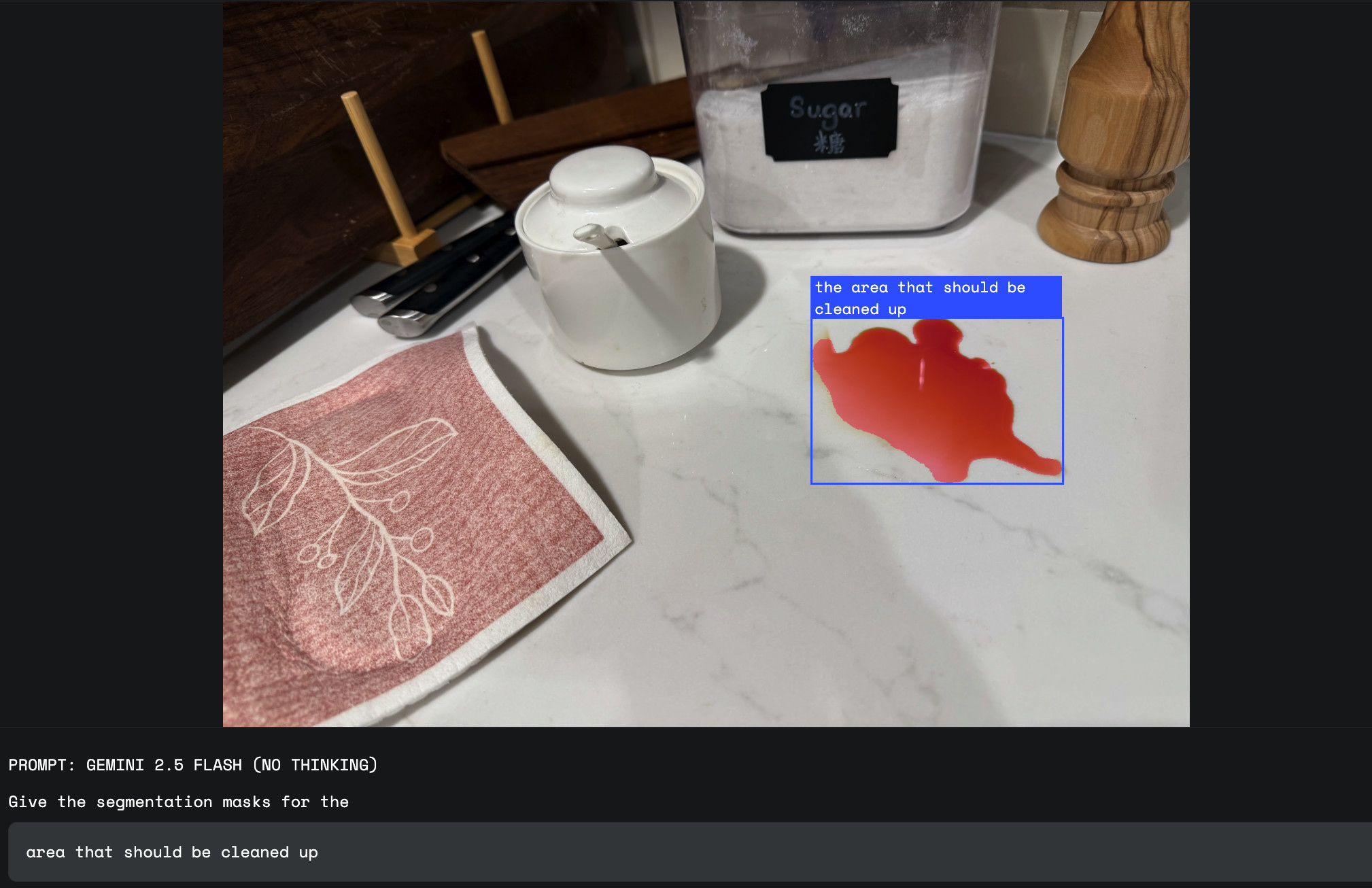

🔼據 Google 表示,連抽象的概念均可以識別出來。例如「損壞」、「髒亂」或「機會」等概念。

技術驅動:Gemini 2.5 的核心能力

Gemini 2.5 作為 Google 最新一代的多模態 AI 模型,其對話式圖像分割功能依賴於強大的技術架構,將語言理解與視覺處理無縫整合。Gemini 2.5 採用了先進的多模態語言-視覺模型,能同時處理圖像和文本輸入。當使用者輸入類似「分割圖片中穿著紅色外套的人」的指令時,模型會解析語言中的關鍵描述(例如「紅色外套」),並將其與圖像中的視覺特徵進行匹配,生成精確的分割掩碼。這種能力得益於模型在海量圖像-文本對數據上的預訓練,使其能夠理解語言與視覺之間的複雜關係。與傳統模型不同,Gemini 2.5 不僅限於識別預定義類別,還能根據描述性語言動態生成分割結果。

此外,Gemini 2.5 的上下文感知能力使其在連續對話中表現出色。例如,使用者可能先要求「分割穿紅色外套的人」,隨後進一步指定「僅保留外套的左袖」。模型能夠根據對話歷史精確定位目標區域,這種交互性對於需要多次迭代的應用場景(如醫療影像分析或設計)尤為重要。這種上下文感知能力源於模型改進的 Transformer 架構,該架構整合了視覺 Transformer(ViT)與自然語言處理模組,實現了高效的跨模態推理。這不僅提升了分割精度,還顯著縮短了處理時間,使其適用於即時應用。

跨領域應用:改變行業工作方式

Gemini 2.5 的對話式圖像分割技術為多個行業帶來了革命性的應用可能性。在醫療影像領域,醫生可以通過自然語言指令分割 CT 或 MRI 掃描中的特定結構,例如「分割肺部掃描中的腫瘤」或「標記心臟中的異常區域」。這種直觀的交互方式降低了對專業分割工具的依賴,同時提高了診斷效率。對於醫療研究人員來說,這項技術還能加速大規模影像數據的分析,例如在流行病學研究中快速標記病變區域。

在創意設計與內容創作領域,設計師能夠利用 Gemini 2.5 快速分割和編輯圖像中的元素。例如,通過指令「移除背景中的人群」或「僅保留畫面中的花朵」,設計師可以在幾秒內完成原本需要數小時的圖像處理工作。這對於廣告、電影製作和社交媒體內容創建尤其有價值。此外,結合生成式 AI 技術,Gemini 2.5 還能進一步實現圖像的編輯與合成,例如將分割出的元素重新組合到新背景中。

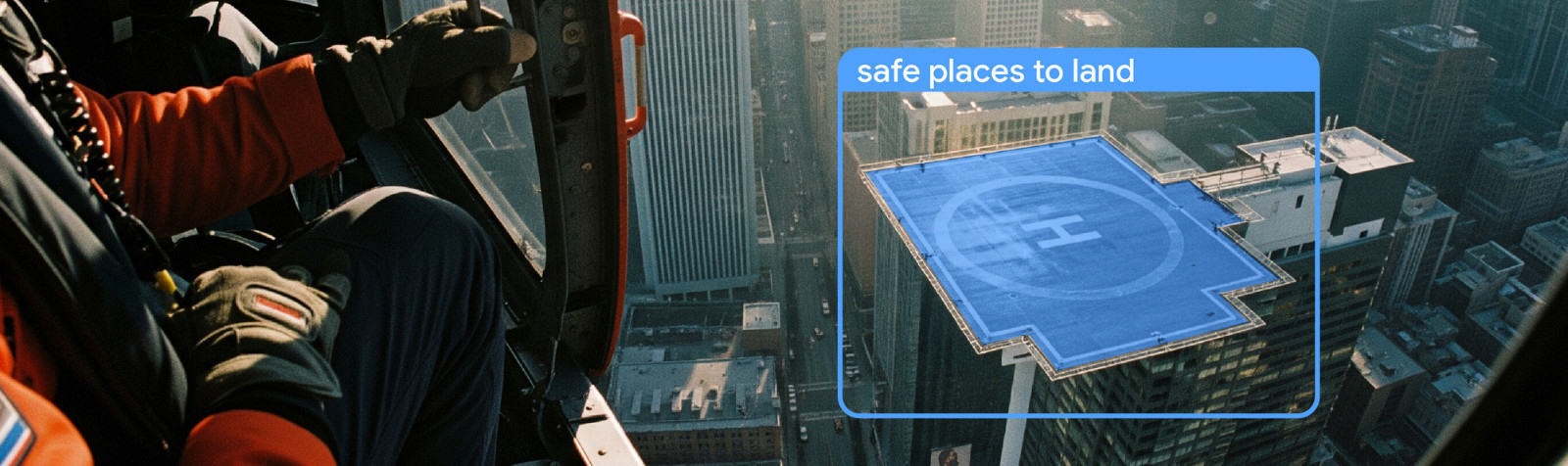

在自動駕駛與機器人領域,對話式圖像分割技術為環境感知提供了新的可能性。例如,自動駕駛系統可以根據指令「分割道路上的行人」或「標記右側的障礙物」來增強對複雜場景的理解。這不僅提高了系統的安全性,還為機器人導航和物體操作提供了更靈活的解決方案。

這項技術在教育與研究領域也有廣泛應用。生物學家可以利用它來分割顯微鏡圖像中的細胞結構,教師則可以通過直觀的語言指令向學生展示圖像分析的過程。這種易用性使得非技術背景的用戶也能參與到高級視覺數據分析中。

優勢與挑戰並存

Gemini 2.5 的對話式圖像分割技術帶來了顯著的優勢,但也面臨一些挑戰。其直觀的自然語言界面極大地降低了技術門檻,使非專業用戶也能輕鬆完成複雜的圖像分割任務。靈活的語言提示支持多樣化的分割需求,從簡單的物體識別到複雜的場景分析,幾乎無所不能。此外,交互式的對話功能允許用戶通過連續指令精煉分割結果,顯著提高了結果的精確度。

但是,語言歧義是一個關鍵問題,例如「紅色的東西」可能指向圖像中的多個物體,導致分割誤差。為了解決這一問題,模型需要進一步優化其對模糊語言的解析能力。此外,多模態模型的高計算需求可能限制其在低端設備上的應用,尤其是在即時場景中。最後,模型的性能可能受到訓練數據的限制,在某些罕見場景或文化背景下可能表現不佳,這需要通過更廣泛的數據集來改善。

展望未來:視覺 AI 的新篇章

Gemini 2.5 的對話式圖像分割技術為視覺 AI 的未來開闢了無限可能。隨著模型的不斷優化,預計其分割精度將進一步提升,甚至可能實現像素級的語義分割,滿足更高精度的應用需求。同時,通過與生成式 AI 的整合,這項技術有望實現更複雜的圖像編輯功能,例如根據語言指令生成全新的視覺內容。此外,隨著計算效率的提高,這項技術可能被應用於移動設備和嵌入式系統,進一步擴展其應用範圍。

Google 的 Gemini 2.5 通過對話式圖像分割技術,將視覺 AI 的交互性推向了新的高度。其多模態架構、上下文感知能力和高效的 Transformer 設計,使其能夠以自然、直觀的方式滿足多樣化的分割需求。從醫療到設計,從自動駕駛到教育,這項技術正在重塑我們與視覺數據的交互方式。儘管面臨語言歧義和計算資源的挑戰,但隨著技術的不斷進步,Gemini 2.5 無疑將引領視覺 AI 的新時代,為各行業帶來深遠的變革。