驅動智能體革命的八大語言模型:LLM 架構全解析 EP2

在人工智慧(AI)快速演進的時代,AI 代理已從基本工具轉變為具備感知、推理與行動能力的自主系統。大型語言模型(Large Language Models,LLM)作為其核心引擎,不再侷限於單一類型,而是發展出多樣化架構,每種專注於特定功能,以提升代理的效率、適應性與智能深度。

本指南聚焦四種關鍵 LLM 類型:小型語言模型(SLM)、大型行動模型(LAM)、階層語言模型(HLM)與大型概念模型(LCM)。這些模型不僅補足傳統 LLM 的局限,還推動 AI 代理向模組化與高效化邁進。例如,SLM 強調資源優化,適合邊緣計算;LAM 橋接推理與執行,實現自動化;HLM 模擬人類層級決策,提升協調;LCM 則在概念層處理抽象知識,強化認知搜尋。透過這些架構,AI 代理能在 2025 年的應用中(如商業自動化或科學模擬)展現更強大潛力。我們將逐一剖析其本質、架構、訓練、應用與挑戰,幫助讀者理解如何在 AI 系統中整合這些模型。

5. 小型語言模型(SLM)

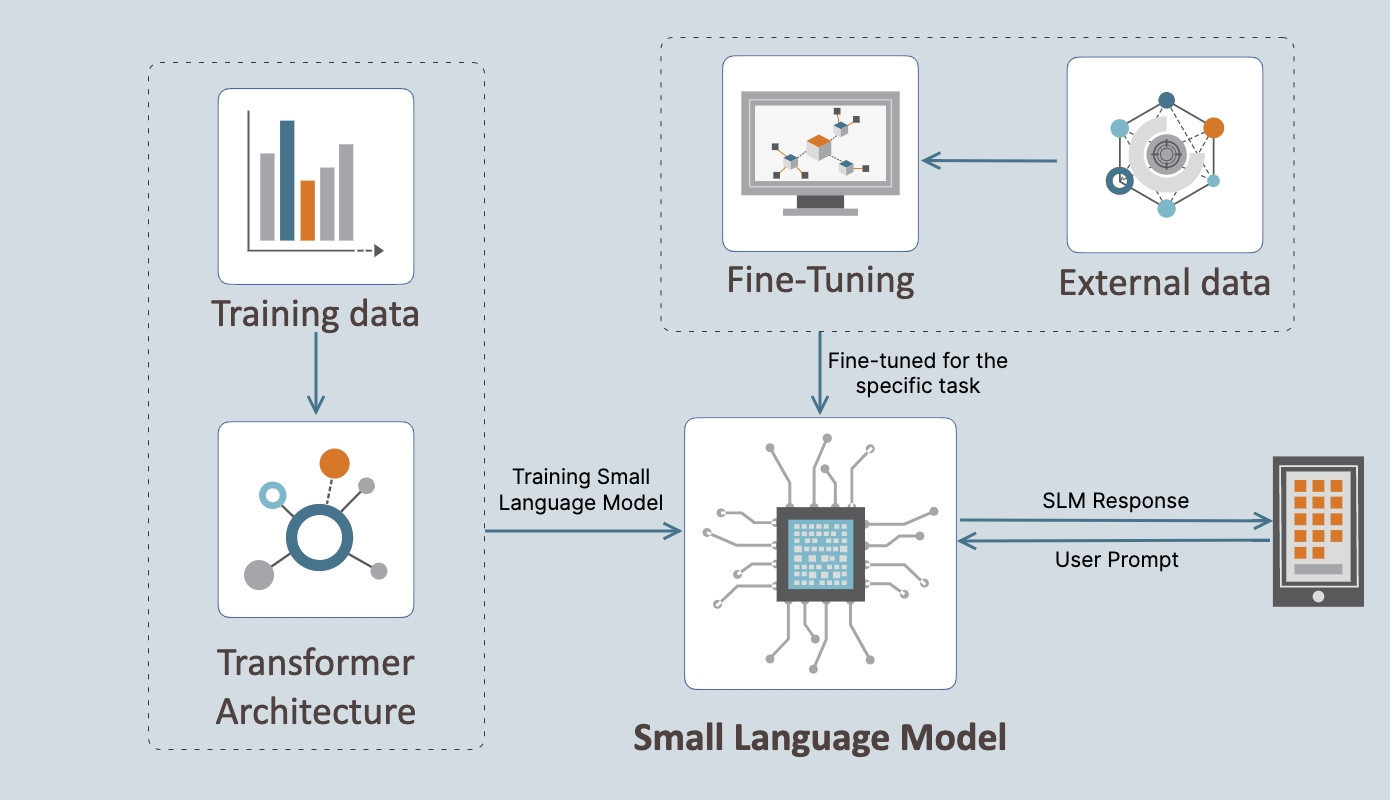

小型語言模型(Small Language Models,SLM)是人工智慧(AI)模型的一種變體,能夠處理、理解並生成自然語言內容。它們在規模與範圍上小於大型語言模型(LLMs),參數量從數百萬到數十億不等,相較於LLM的數千億或萬億參數更為精簡。這些內部變數(如權重與偏差)在訓練期間學習而成,讓SLM在資源受限環境中高效運作。在AI代理中,SLM扮演關鍵角色,能驅動自主任務,如工具呼叫或檢索增強生成(RAG),提供低延遲的回應,適合邊緣設備或行動應用,讓代理在離線或隱私敏感情境中實現即時決策。例如客戶服務聊天機器人或預測維護系統。

Transformer包括編碼器(encoders),將輸入序列轉換為捕捉語義與標記位置的嵌入(embeddings);自注意力機制(self-attention),讓模型聚焦重要標記而不受位置限制;以及解碼器(decoders),利用自注意力與嵌入生成最可能的輸出序列。SLM通常從LLM壓縮而來,使用模型壓縮技術:剪枝(pruning),移除冗餘參數(如權重、神經元或層),常需後續微調恢復準確性;量化(quantization),將高精度數據(如32位浮點數)轉為低精度(如8位整數),加速推理,可分為量化感知訓練(QAT)或後訓練量化(PTQ);低秩因子分解(low-rank factorization),將權重矩陣分解為較小近似,減少計算但需微調;以及知識蒸餾(knowledge distillation),從預訓練的「教師」LLM轉移知識至「學生」SLM,模擬推理,常使用離線蒸餾凍結教師權重。這讓SLM在邊緣或行動裝置上部署,實現離線推理、低延遲與隱私保護。

SLM的架構基於Transformer模型,這是自然語言處理(NLP)的核心神經網路架構。Transformer包括:

- 編碼器(encoders):將輸入序列轉換為捕捉語義與標記位置的嵌入(embeddings)。

- 自注意力機制(self-attention):讓模型聚焦重要標記而不受位置限制。

- 解碼器(decoders):利用自注意力與嵌入生成最可能的輸出序列。

SLM通常從LLM壓縮而來,使用模型壓縮技術:

- 剪枝(pruning):移除冗餘參數(如權重、神經元或層),常需後續微調恢復準確性。

- 量化(quantization):將高精度數據(如32位浮點數)轉為低精度(如8位整數),加速推理,可分為量化感知訓練(QAT)或後訓練量化(PTQ)。

- 低秩因子分解(low-rank factorization):將權重矩陣分解為較小近似,減少計算但需微調。

- 知識蒸餾(knowledge distillation):從預訓練的「教師」LLM轉移知識至「學生」SLM,模擬推理,常使用離線蒸餾凍結教師權重。

這讓SLM在邊緣或行動裝置上部署,實現離線推理、低延遲與隱私保護。

圖5:SLM基於Transformer的壓縮架構,強調剪枝與量化機制

訓練SLM主要透過從LLM衍生,應用壓縮與蒸餾方法。剪枝或分解後常進行微調恢復準確性。知識蒸餾讓學生模型匹配教師的預測與推理,提供細粒度指導。量化可整合至訓練(QAT)以提升準確性,或後訓練應用(PTQ)以節省資源。整體過程聚焦資源效率,讓SLM適合企業領域的特定任務微調,如RAG整合外部知識確保回應接地氣。與LLM不同,SLM訓練成本低、能源消耗少,支援混合模式(如SLM處理簡單查詢、LLM處理複雜數據),提升AI代理的靈活性。

在AI代理應用中,SLM的精簡性使其適合資源受限環境,提供快速回應與領域特定微調。用例包括:

- 聊天機器人:用於客戶服務或代理AI完成任務。

- 內容摘要化:如Llama 3.2處理討論或Gemini Nano摘要音頻/轉錄。

- 生成式AI:如Granite模型解釋或翻譯程式碼。

- 語言翻譯:保留脈絡。

- 邊緣/IoT預測維護:即時分析數據。

- 情緒分析:用於文本分類。

- 車輛導航:結合多模態能力(語音/圖像)與RAG遵守規則。

SLM支援代理中的工具呼叫與RAG,讓代理在行動裝置或內部部署中自主運作,提升隱私與永續性。

知名SLM範例包括:

- Gemma:從Gemini蒸餾,2B/7B/9B參數,轻量變體如Gemini 1.5 Flash-8B與Nano用於行動。

- GPT-4o mini:多模態,文本/圖像輸入、文本輸出,成本效益高,經API與ChatGPT存取。

- Granite:IBM開源系列,3.0集合中2B/8B參數,使用MoE低延遲,優化企業任務如網路安全與RAG,經watsonx、Vertex AI、Hugging Face提供。

- Llama:Meta開源,Llama 3.2在1B/3B參數量化加速,多語言。

- Ministral:Mistral AI,3B與8B參數,滑動視窗注意力加速推理。

- Phi:Microsoft,Phi-2 2.7B、Phi-3-mini 3.8B,Phi-3-small 7B即將,長脈絡推理。

截至2025年,這些模型持續進化,Granite 3.2與Phi-3變體整合更多混合架構,提升代理效能。

SLM的效能透過基準測試驗證,聚焦語言理解、問答、推理、數學與程式碼生成。GPT-4o mini在這些基準上優於GPT-3.5 Turbo,接近GPT-4o;Ministral 8B在知識、常識、數學與多語言基準上優於Mistral 7B。SLM在針對性任務上匹配或超越LLM,但廣度較窄。

6. 大型行動模型(LAM)

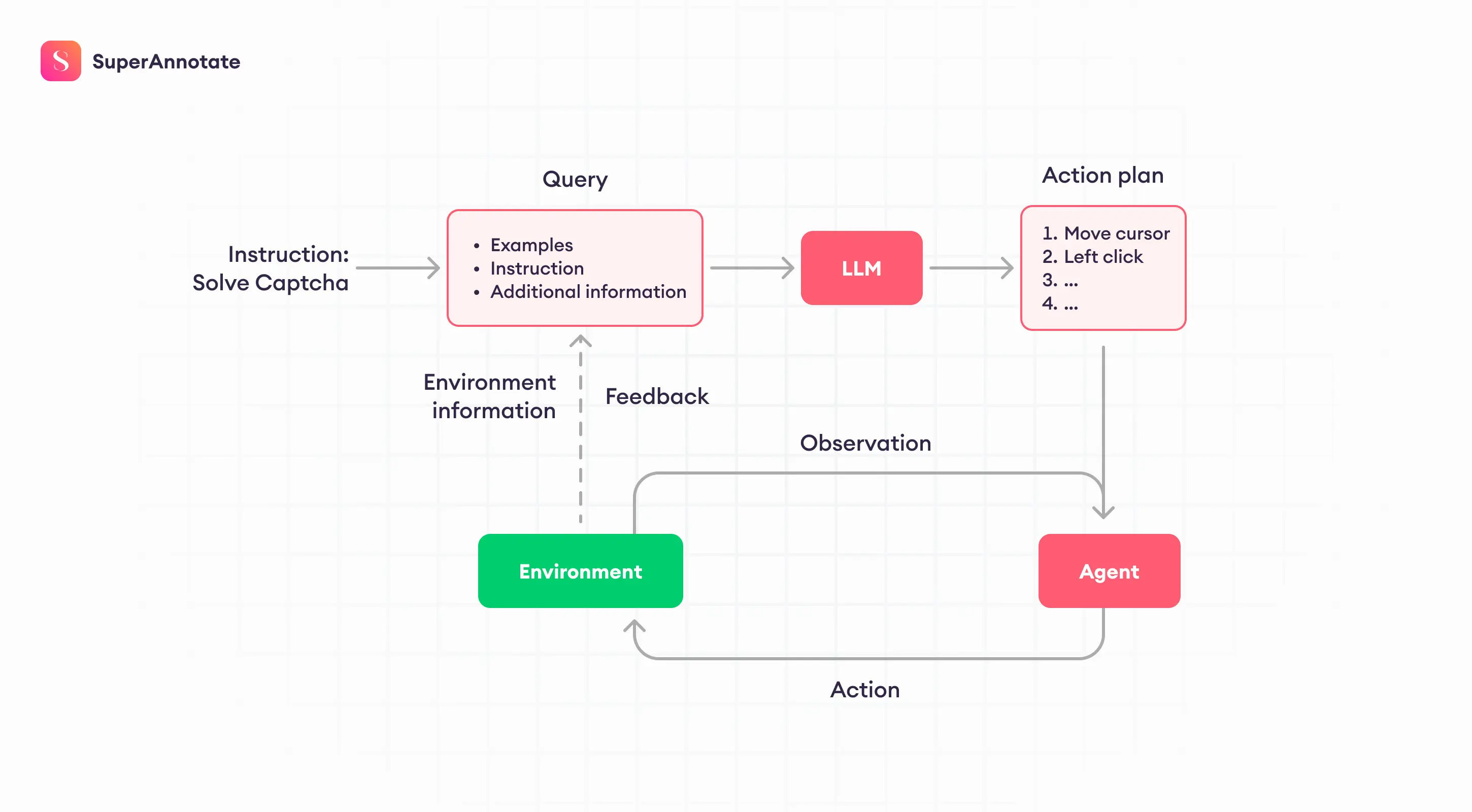

大型行動模型(Large Action Models,LAM)是人工智慧(AI)模型的進階形式,專注於理解人類意圖並將其轉換為可執行的行動,而非僅生成文本或推理。LAM 透過自然語言指令與外部環境互動,能夠規劃多步驟任務、呼叫 API 或操作應用程式,實現端到端自動化。在 AI 代理中,LAM 扮演核心角色,讓代理從被動回應轉向主動執行,例如在商業流程中自動處理訂單或在虛擬環境中導航介面,標誌著 AI 從語言理解邁向實際行動的轉變。

LAM 的架構通常建立在大型語言模型(LLM)基礎上,但擴展為行動導向系統。核心組件包括:

- 語言理解模組(語言編碼器):用以解析用戶指令。

- 行動規劃器:將指令分解為步驟序列。

- 環境互動層:透過觀察反饋循環調整行動。

LAM 採用混合方法,如結合 LLM 與強化學習(RL),讓模型學習從環境中獲取反饋並優化行動。與傳統 LLM 不同,LAM 整合工具呼叫與 API 接口,能處理動態環境,例如在 Rabbit AI 中,LAM 模擬人類操作電腦介面,執行如滑鼠點擊或鍵盤輸入的低階行動。這讓 LAM 在複雜任務中實現閉環控制,從指令到執行再到驗證。

訓練 LAM 涉及多模態數據與強化學習策略,讓模型學習將語言轉換為行動。常見方法包括:

- 對比學習:將人類示範行動與指令配對。

- 生成式訓練:模擬環境互動產生新行動序列。

- 預訓練模型轉移:從 LLM 如 GPT 系列衍生,加入行動特定細調。

訓練數據來自真實世界互動記錄,如使用者介面操作或 API 呼叫日誌,讓 LAM 學習處理不確定性與錯誤恢復。與 VLM 類似,LAM 可使用遮罩技術預測隱藏行動步驟,或透過零樣本學習適應新環境。整體過程資源密集,但聚焦行動效率,讓 AI 代理在動態場景中自主運作。

在 AI 代理應用中,LAM 的實用性廣泛,從自動化商業任務到人機互動。首要用例是任務執行,如 Rabbit AI 的 r1 裝置,能根據語音指令預訂機票或叫車,透過 LAM 直接操作應用程式。其次,在製造業中,LAM 支援預測維護,分析感測器數據並自動觸發修復工作流。醫療領域則用於遠距診斷,LAM 整合患者數據生成行動計劃,如安排追蹤檢查。電商中,LAM 能處理客戶查詢並執行退貨流程,提升使用者體驗。此外,在遊戲或虛擬實境中,LAM 驅動 NPC 代理,實現動態互動。這些應用橋接智能與自動化,讓 AI 代理成為真正自主系統。

知名 LAM 範例包括:

- Rabbit AI 的 r1:2024 年推出,使用 LAM 模擬人類操作,處理如購物或預訂的複雜任務。

- AI21 Labs 的 Jamba:2025 年變體,支援行動規劃與 API 整合。

- Toloka 的 LAM 系統:聚焦人機互動,處理介面導航。

- GeeksforGeeks 提及的開源變體:如基於 Llama 的行動微調模型。

其他如 Trinetix 的企業級 LAM,用於商業自動化;SuperAnnotate 的視覺增強 LAM,結合 VLM 元素。這些模型在 2025 年已廣泛整合至 AI 代理框架,如 OpenAI 的工具呼叫系統。

7. 階層語言模型(HLM)

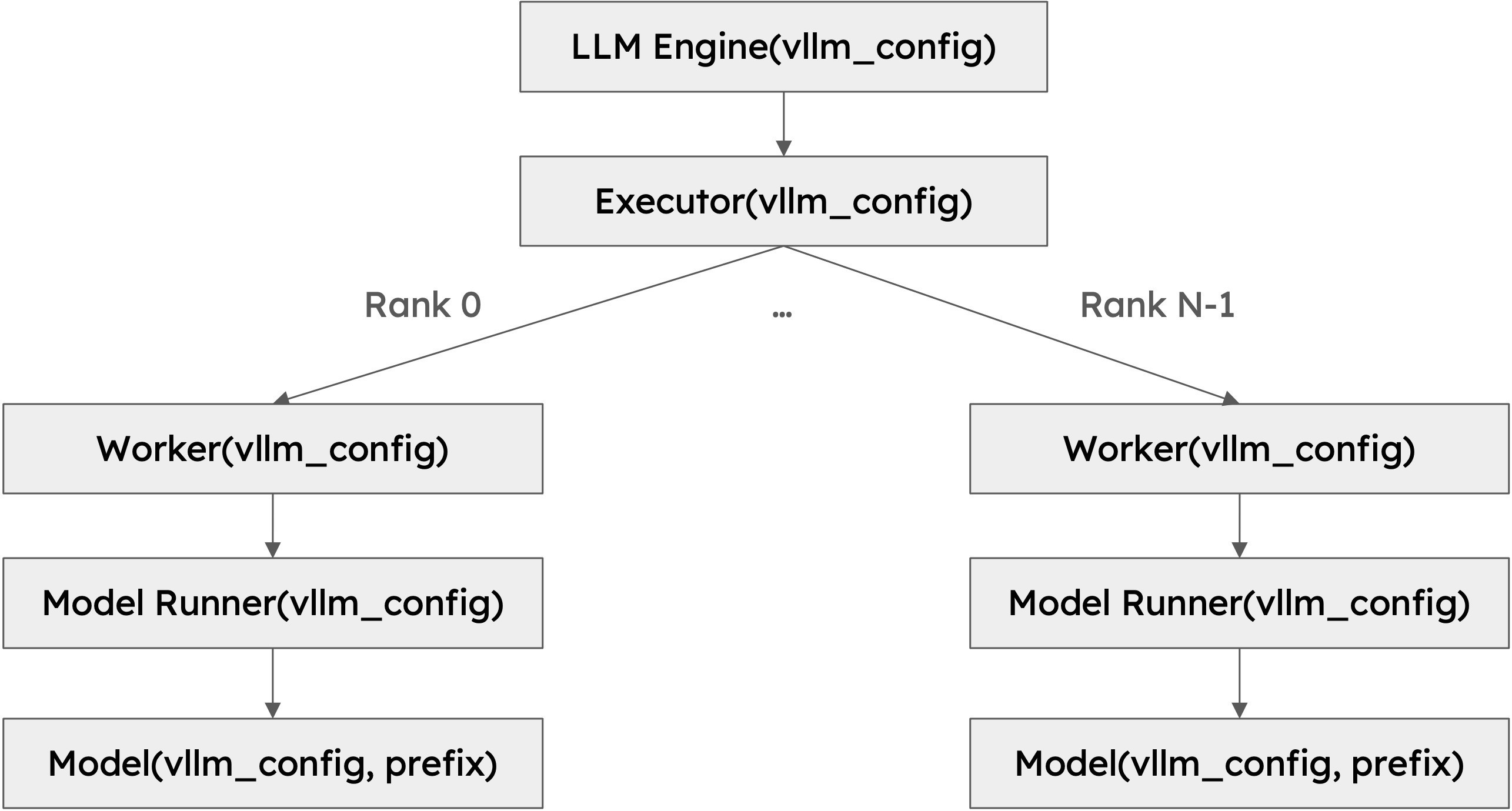

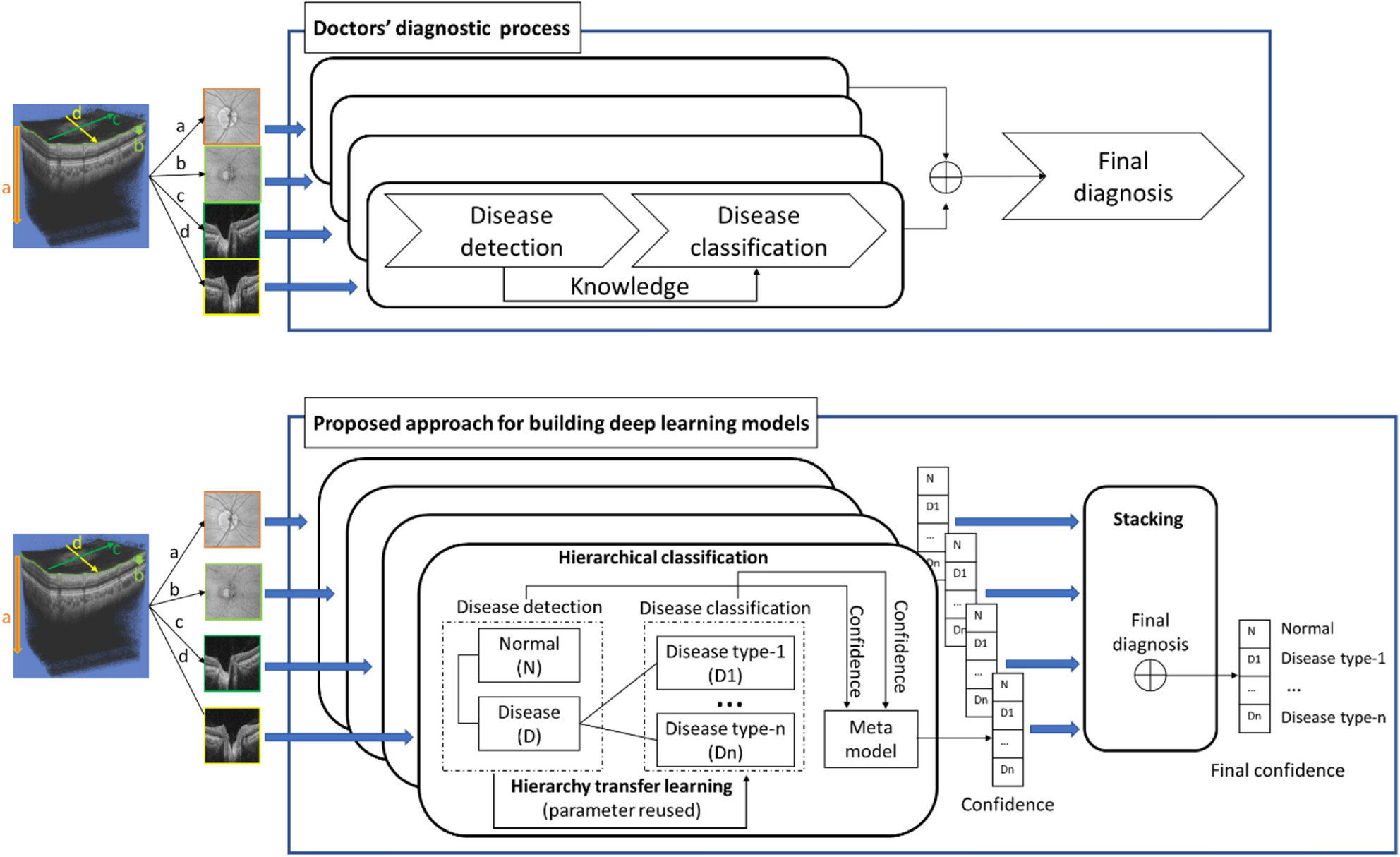

階層語言模型(Hierarchical Language Models,HLM)是大型語言模型(LLM)的進階架構,以層級結構組織智能,讓高層模型負責整體規劃與目標設定,低層模型則處理特定子任務與領域細節。這類模型模擬人類認知的分工模式,能分解複雜問題為可管理的步驟,並透過結構化提示或記憶層溝通層級間資訊。在AI代理中,HLM提升可擴展協調性,讓代理能處理多模組任務,如在遊戲中規劃策略或在商業中自動化工作流,實現更高效的模組化系統設計。

HLM的架構採用多層設計,高層規劃器(planner)協調低層專家子模型,類似人類的層級決策。高層聚焦抽象目標,低層專注執行細節,常使用兩塊架構(如HLM-G的局部塊捕捉節點資訊,全局塊處理互動結構)。整合Transformer的自注意力機制,讓模型捕捉長程依賴與層級關係,優於傳統平面LLM。與VLM類似,HLM可融合多模態,但強調層級解釋性,透過注意力權重提供可視化洞見,減少計算成本並提升圖形或序列任務的穩健性。

訓練HLM涉及層級優化,從預訓練LLM衍生,應用強化學習(RL)激勵層級推理行為。高層學習規劃策略,低層細調特定領域,使用對比學習對齊層級輸出。訓練數據包括結構化序列或圖形,讓模型學習分解與聚合。挑戰在於層級協調,需噪音頂-k路由或正則化避免不平衡。與VLM的對比/遮罩類似,HLM可預測層級隱藏元素,提升泛化。

在AI代理應用中,HLM的模組化適合複雜協調,如HLA在Overcooked遊戲中實現人類-AI即時協作。高層規劃整體策略,低層執行動作,提升任務效率。用例包括推薦系統(層級捕捉用戶偏好)、圖形推理(HLM-G處理節點/鏈接/圖形任務)與實時代理(如Voyager的遊戲導航)。這讓代理在多代理環境中合作,支援商業自動化與科學模擬。

知名HLM範例包括:

- HLM-G:arXiv 2024,圖形推理兩塊架構。

- HRM(Hierarchical Reasoning Model):腦啟發模型,優於LLM推理。

- AutoGPT:多層代理規劃。

- Voyager:遊戲層級探索。

- CAMEL:協作代理層級。

- HLA:Overcooked人類-AI協調。

2025年,HRM變體整合RL,優化層級推理。

HLM的效能透過基準測試驗證,聚焦層級任務如圖形推理(節點/鏈接/圖形級準確率)與解釋性(注意力權重評估)。HLM-G在綜合評估中優於基線,提升實世界應用穩健性。指標包括計算效率、泛化與協調平衡。

8. 大型概念模型(LCM)

大型概念模型(Large Concept Models,LCM)是人工智慧(AI)模型的創新架構,在更高語義層級運作,專注於理解與生成概念而非單詞。它們映射知識圖譜、抽象推理與領域本體,讓AI代理能進行深層語義處理,從而產生更連貫且脈絡豐富的輸出。這類模型不僅提升AI代理的認知能力,還使其在複雜任務中實現「概念級推理」,例如在認知搜尋或領域特定輔助中,代理可根據抽象概念生成決策或洞見,標誌著從傳統LLM向更智能系統的演進。

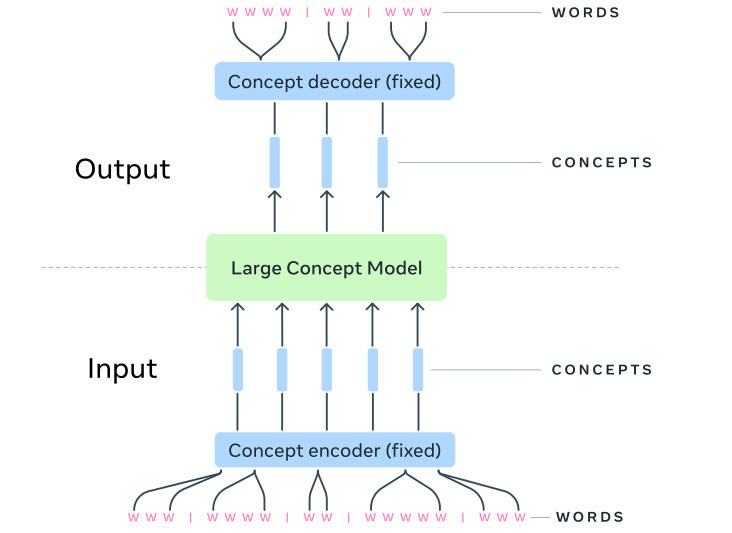

LCM的架構以概念為核心,包含三個主要組件:

- 概念編碼器(concept encoder):負責將輸入單詞或短語轉換為固定概念表示,捕捉語義相似性。

- 大型概念模型核心:在概念空間中進行預測與生成,利用Transformer的自注意力機制處理抽象關係。

- 概念解碼器(concept decoder):將概念轉回可讀輸出。

與傳統LLM不同,LCM在概念層級操作,避免詞彙碎片化,提升多語言與多模態泛化。這讓LCM在知識圖譜或本體任務中更高效,減少計算需求並改善解釋性。

訓練LCM強調概念抽象化,從預訓練LLM衍生,使用對比學習將概念嵌入對齊知識圖譜。常見策略包括:

- 生成式訓練:產生新概念序列。

- 遮罩學習:預測隱藏概念以提升魯棒性。

- 知識蒸餾:從LLM轉移語義知識。

訓練數據來自結構化來源如本體庫或知識圖譜,讓模型學習跨領域概念關聯。與VLM類似,LCM可利用預訓練模型降低成本,例如整合BERT或GPT的編碼器。整體過程聚焦語義效率,讓AI代理在抽象推理中表現優異。

在AI代理應用中,LCM的語義深度廣泛用於認知任務。首先,認知搜尋可生成概念級查詢結果,提升資訊檢索準確性。其次,抽象推理支援科學模擬或邏輯推斷,讓代理處理複雜情境。領域特定copilots如醫療診斷,可解釋推理路徑,提供透明決策。其他用例包括推薦系統(概念相似性匹配)與內容生成(確保連貫性)。這些應用橋接抽象與實務,讓AI代理成為高階智能夥伴。

知名LCM範例包括:

- Meta的LCM:2024年論文提出,操作概念表示,提升語言生成。

- LCM-Llama:Meta變體,整合Llama架構。

- DeepSeek-LCM:2025年開源,支援多模態概念。

其他如InfoQ提及的混合系統,結合LCM推理與LLM流暢性。這些模型在2025年廣泛整合至AI代理框架。

LCM的效能透過基準測試驗證,聚焦概念準確性與語義推理,如MMMU類似多學科測試,測量知識與推理技能。工具如LMMs-Eval可評估概念整合。LCM在這些基準上優於傳統LLM,尤其在抽象任務中。

儘管強大,LCM仍面臨挑戰:

- 偏見:源自數據,需多樣化來源緩解。

- 成本與複雜度:概念抽象需資源。

- 泛化不足:對新概念適應差,可用零樣本學習改善。

- 幻覺:輸出需驗證。

這些促使開發者強化LCM的安全性,讓AI代理更可靠應用於生產環境。