到底什麼是深度學習?Deep Learning 入門指南

深度學習 (Deep Learning) 是什麼?本文將解釋神經網路、訓練過程與常見架構,帶你快速了解這門人工智慧的核心技術與限制。

什麼是深度學習 (Deep Learning)?

想像一下,你在教小孩認識動物。一開始,你會給他看很多貓咪的照片,告訴他「這是一隻貓」。慢慢地,孩子就能自己分辨出貓咪,即使看到從未見過的貓咪品種也能認出來。深度學習 (Deep Learning) 原理就是如此:透過觀察大量的例子,電腦逐漸學會辨識,最終能夠獨立做出判斷。

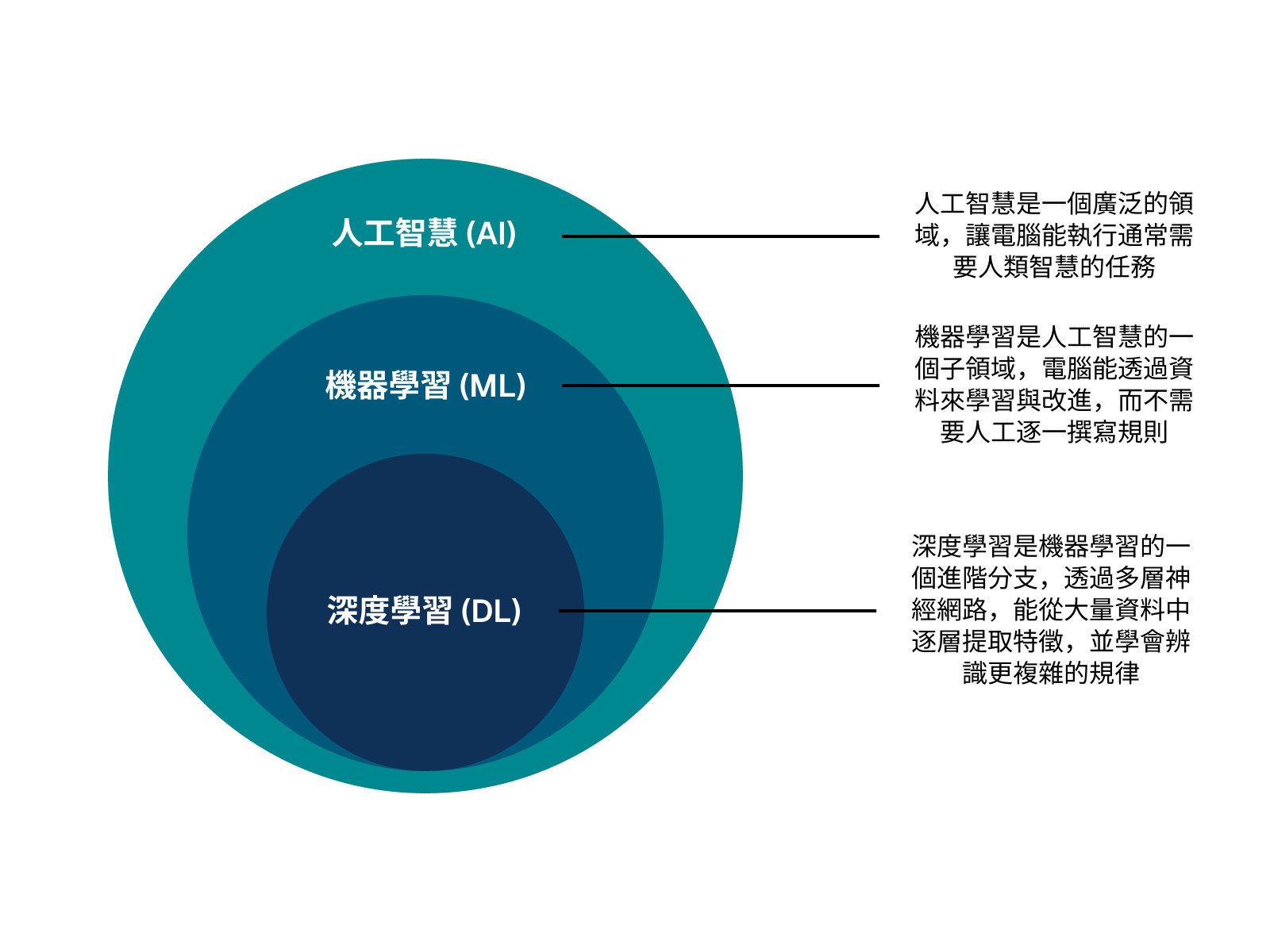

深度學習是人工智慧 (AI) 的一個重要分支,它模仿人類大腦的學習方式,讓電腦能夠從經驗中學習和改進。更具體來說,深度學習是機器學習 (Machine Learning) 的一個子領域,使用稱為「神經網路」的結構來處理資訊。

深度學習和大腦的關聯

深度學習的靈感其實來自我們的人腦。大腦裡有數十億個神經元,它們會彼此傳遞訊號,訊息在一層一層的神經元處理下逐漸變得有意義。人工神經網路就是模仿這個過程,把資料交給一個個「人工神經元」處理,每一層都會對資訊做出一些轉換與過濾,最後在多層傳遞之後,電腦就能得出一個答案。

深度學習的核心:神經網路的層次結構

舉貓咪作為例子:

- 輸入層 (第一層):接收原始資料 (例如圖片的像素)

- 隱藏層 (中間層):逐步提取特徵

- 第一隱藏層:認識基本形狀 (邊緣、線條)

- 第二隱藏層:組合形狀 (眼睛、耳朵)

- 第三隱藏層:辨認整體 (這是一隻貓)

- 輸出層 (最後一層):給出最終答案

深度學習的「深度」指的是這些隱藏層的數量。傳統神經網路可能只有 1-2 層,而深度神經網路可以有幾十層甚至上百層。這種由淺入深的處理方式,使深度學習能比傳統電腦程式更聰明,因為它不需要我們先告訴它規則,而是自己歸納規則。

深度學習的訓練過程:從錯誤中進步

電腦在深度學習中學習的方式,其實就像學生不斷做練習題並從錯誤中進步。當一張圖片或一段資料被輸入到神經網路時,訊息會一層一層地傳遞下去,最後網路會給出一個答案,這個過程叫做前向傳播 (Forward Propagation)。

不過,電腦一開始常常會答錯,因此需要一個方法來衡量錯誤的程度,這也稱作計算誤差。接下來,這個錯誤訊息會被送回去,告訴每一層神經元「你在這個錯誤中有多少責任」,這個過程稱為反向傳播 (Backward Propagation)。

最後,系統會根據這些訊息來微調每個神經元之間的連結強度,這個步驟叫做調整權重 (Weight Adjustment)。這四個步驟會重複上千次甚至上萬次,每一次都讓模型表現更好。

常見的深度學習架構

不同任務需要不同的網路結構,這裡用簡單的語言解釋幾個核心:

卷積神經網路 (CNN):專門處理圖片。它像一個放大鏡,會一小塊一小塊地掃描圖片,找出特徵。這就是為什麼它特別擅長人臉辨識或醫學影像。 循環神經網路 (RNN):處理有順序的資料,例如語音或文字。它有記憶功能,能記住前面的資訊,用來幫助判斷後面的內容。

Transformer:現在最重要的架構,用於自然語言處理。它的注意力機制能讓模型像人一樣,在一句話裡特別關注關鍵字。ChatGPT 就是基於這個架構。

深度學習需要什麼?

要訓練出有效的深度學習模型,必須同時具備三個關鍵條件:

大量資料:就像學生需要大量練習題一樣,深度學習需要許多例子。資料越多,電腦就越能抓到規律,判斷也會更準確。

強大算力:深度學習的計算量非常龐大,往往需要 GPU 或雲端運算來加速,否則訓練一個模型可能會花上好幾天甚至幾週。

合適的演算法與工具:像 PyTorch、TensorFlow 這些框架,能幫助研究人員更快速方便地設計和訓練模型,讓開發過程更高效。

深度學習的限制

訓練一個成功的模型往往非常困難。它需要大量乾淨且多樣的資料以及高效能的硬體來支撐龐大的運算量,這對許多研究或應用都是一大挑戰。此外,深度學習也存在偏見問題:如果訓練資料本身不完整或有偏差,模型的輸出結果就可能不公平甚至錯誤。更重要的是,模型的內部運作通常難以解釋,人們常把它稱為「黑箱」,這使得結果雖然準確,卻不一定能讓人理解得出這個結論的理由。

總結

深度學習的本質,其實就是讓電腦透過模仿人腦的方式,從大量資料裡自己學出規律。理解它並不需要數學公式或程式碼,只要抓住幾個核心:它是「多層神經網路」、它靠不斷練習修正錯誤來進步,而且它的應用正在快速擴展到我們生活的各個角落。深度學習代表了一種新的思維方式:電腦不再只是照著指令行事,而是能靠經驗成長。這也是為什麼它會成為人工智慧時代的基礎。